Основы теории информации

Практическая работа № 1

«Измерение количества информации»

Цель : получить навыки измерения количества информации. Научится рассчитывать размер файлов в зависимости от типа данных в файле и количества информации, занимаемого логической единицей данных.

Теоретическая часть

Для передачи информации, необходимой для передачи наиболее важных вещей, потребовалось много времени до и после обработки. Трудно представить себе, какой бы нефильтрованный поток информации не сделал бы для потребителей: результатом была бы незащищенность и страх.

Прежде чем перейти к журналистике, Бетманн закончил коммерческое обучение и изучил деловое администрирование в Берлине. Основываясь на таком опыте, Фрэнк Бетманн научился отслеживать вещи в хаотической новостной ситуации. Он дает советы, которые могут быть применены к повседневной работе в других профессиях.

Процесс познания окружающего мира приводит к накоплению информации в форме знаний (фактов, научных теорий и т. д.). Получение новой информации приводит к расширению знаний или, как иногда говорят, к уменьшению неопределенности знания. Если некоторое сообщение приводит к уменьшению неопределенности нашего знания, то можно говорить, что такое сообщение содержит информацию. Например, после сдачи зачета или выполнения контрольной работы вы мучаетесь неопределенностью, вы не знаете, какую оценку получили. Наконец, преподаватель объявляет результаты, и вы получаете одно из двух информационных сообщений: "зачет" или "незачет", а после контрольной работы одно из четырех информационных сообщений: "2", "3", "4" или "5". Информационное сообщение об оценке за зачет приводит к уменьшению неопределенности вашего знания в два раза, так как получено одно из двух возможных информационных сообщений. Информационное сообщение об оценке за контрольную работу приводит к уменьшению неопределенности вашего знания в четыре раза, так как получено одно из четырех возможных информационных сообщений. Ясно, что чем более неопределенна первоначальная ситуация (чем большее количество информационных сообщений возможно), тем больше мы получим новой информации при получении информационного сообщения (тем в большее количество раз уменьшится неопределенность знания).

Если вы все еще не можете объяснить текущее событие, опишите первые впечатления, настроения и процессы.

- Если вы ничего не знаете, спросите кого-нибудь, кто может это знать.

- Только расскажите, что вы поняли за короткое время.

- Опишите сложные отношения как можно проще.

Количество информации можно рассматривать как меру уменьшения неопределенности знания при получении информационных сообщений. Рассмотренный выше подход к информации как мере уменьшения неопределенности знания позволяет количественно измерять информацию. Существует формула (1), которая связывает между собой количество возможных информационных сообщений N и количество информации i, которое несет полученное сообщение:

Бит. Для количественного выражения любой величины необходимо сначала определить единицу измерения. Так, для измерения длины в качестве единицы выбран метр, для измерения массы - килограмм и т. д. Аналогично, для определения количества информации необходимо ввести единицу измерения. За единицу количества информации принимается такое количество информации, которое содержится в информационном сообщении, уменьшающем неопределенность знания в два раза. Такая единица названа битом.

Производные единицы измерения количества информации. Минимальной единицей измерения количества информации является бит, а следующей по величине единицей - байт, причем:

1 байт = 8 битов = 23 битов.

В информатике система образования кратных единиц измерения несколько отличается от принятых в большинстве наук. Традиционные метрические системы единиц, например Международная система единиц СИ, в качестве множителей кратных единиц используют коэффициент 10 n , где n = 3, 6, 9 и т. д., что соответствует десятичным приставкам "Кило" (10 3), "Мега" (10 6), "Гига" (10 9) и т. д.

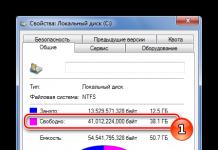

В компьютере информация кодируется с помощью двоичной знаковой системы, и поэтому в кратных единицах измерения количества информации используется коэффициент 2 n . Так, кратные байту единицы измерения количества информации вводятся следующим образом:

1 Килобайт (Кбайт) = 210 байт = 1024 байт;

1 Мегабайт (Мбайт) = 210 Кбайт = 1024 Кбайт;

1 Гигабайт (Гбайт) = 210 Мбайт = 1024 Мбайт.

1 Терабайт (Тб) = 1024 Гбайта = 240 байта,

1 Петабайт (Пб) = 1024 Тбайта = 250 байта.

Формулу для вычисления количества информации, учитывающую неодинаковую вероятность событий, предложил К. Шеннон в 1948 году. Количественная зависимость между вероятностью события р и количеством информации в сообщении о нем x выражается формулой: x=log 2 (1/p). Качественную связь между вероятностью события и количеством информации в сообщении об этом событии можно выразить следующим образом - чем меньше вероятность некоторого события, тем больше информации содержит сообщение об этом событии.

Рассмотрим некоторую ситуацию. В коробке имеется 50 шаров. Из них 40 белых и 10 черных. Очевидно, вероятность того, что при вытаскивании "не глядя" попадется белый шар больше, чем вероятность попадания черного. Можно сделать заключение о вероятности события, которые интуитивно понятны. Проведем количественную оценку вероятности для каждой ситуации. Обозначим p ч - вероятность попадания при вытаскивании черного шара, р б - вероятность попадания белого шара. Тогда: р ч =10/50=0,2; р б 40/50=0,8. Заметим, что вероятность попадания белого шара в 4 раза больше, чем черного. Делаем вывод: если N - это общее число возможных исходов какого-то процесса (вытаскивание шара), и из них интересующее нас событие (вытаскивание белого шара) может произойти K раз, то вероятность этого события равна K/N. Вероятность выражается в долях единицы. Вероятность достоверного события равна 1 (из 50 белых шаров вытащен белый шар). Вероятность невозможного события равна нулю (из 50 белых шаров вытащен черный шар). Количественная зависимость между вероятностью события р и количеством информации в сообщении о нем x выражается формулой:

В задаче о шарах количество информации в сообщении о попадании белого шара и черного шара получится:

Рассмотрим некоторый алфавит из m символов: и вероятность выбора из этого алфавита какой-то i-й буквы для описания (кодирования) некоторого состояния объекта. Каждый такой выбор уменьшит степень неопределенности в сведениях об объекте и, следовательно, увеличит количество информации о нем. Для определения среднего значения количества информации, приходящейся в данном случае на один символ алфавита, применяется формула

В случае равновероятных выборов p=1/m. Подставляя это значение в исходное равенство, мы получим

Рассмотрим следующий пример. Пусть при бросании несимметричной четырехгранной пирамидки вероятности выпадения граней будут следующими: p 1 =1/2, p 2 =1/4, p 3 =1/8, p 4 =1/8, тогда количество информации, получаемое после броска, можно рассчитать по формуле:

Расчёт иформационного объема текстового сообщения

Расчёт информационного объёма текстового сообщения (количества информации, содержащейся в информационном сообщении) основан на подсчёте количества символов в этом сообщении, включая пробелы, и на определении информационного веса одного символа, который зависит от кодировки, используемой при передаче и хранении данного сообщения.

В традиционной кодировке (Windows, ASCII) для кодирования одного символа используется 1 байт (8 бит). Эта величина и является информационным весом одного символа. Такой 8-ми разрядный код позволяет закодировать 256 различных символов, т.к. 2 8 =256.

В настоящее время широкое распространение получил новый международный стандарт Unicode, который отводит на каждый символ два байта (16 бит). С его помощью можно закодировать 2 16 = 65536 различных символов.

Итак, для расчёта информационного объёма текстового сообщения используется формула

V text = n симв *i / k сжатия, (2)

где V text – это информационный объём текстового сообщения, измеряющийся в байтах, килобайтах, мегабайтах; n симв – количество символов в сообщении, i – информационный вес одного символа, который измеряется в битах на один символ; k сжатия – коэффициент сжатия данных, без сжатия он равен 1.

Информация в кодировке Unicode передается со скоростью 128 знаков в секунду в течение 32 минут. Какую часть дискеты ёмкостью 1,44Мб займёт переданная информация?

Дано

:

v = 128 символов/сек;

t = 32 минуты=1920сек;

i = 16 бит/символ

Решение:

n симв = v*t = 245760 символов

V=n симв *i = 245760*16 = 3932160 бит = 491520 байт = 480 Кб = 0,469Мб, что составляет 0,469Мб*100%/1,44Мб = 33% объёма дискеты

Ответ: 33% объёма дискеты будет занято переданным сообщением

Теория

Алфавитный подход основан на том, что всякое сообщение можно закодировать с помощью конечной последовательности символов некоторого алфавита.

Алфавит - упорядоченный набор символов, используемый для кодирования сообщений на некотором языке.

Мощность алфавита - количество символов алфавита.

Двоичный алфавит содержит 2 символа, его мощность равна двум.

В традиционной кодировке (КОИ8-Р, Windows, MS DOS, ISO) для кодирования одного символа используется 1 байт (8 бит). Эта величина и является информационным весом одного символа. Такой 8-ми разрядный код позволяет закодировать 256 различных символов, т.к. 2 8 =256 (т.е. используется алфавит из 256 символов).

В настоящее время широкое распространение получил новый международный стандарт Unicode, который отводит на каждый символ два байта (16 бит). С его помощью можно закодировать 2 16 =65536 различных символов.

Чтобы определить объем информации в сообщении (информационный объем сообщения) при алфавитном подходе, нужно последовательно решить задачи:

1. Определить количество информации (i) в одном символе по формуле 2 i = N, где N - мощность алфавита

2. Определить количество символов в сообщении (m), включая пробелы

3. Вычислить объем информации по формуле: V = i * m.

Примеры

1. Книга содержит 150 страниц. На каждой странице размещается 35 строк, в каждой строке – 50 символов. Рассчитать объем информации, содержащейся в книге, ответ записать в Кб.

Решение: Т. к. один символ – 1 байт, то страница содержит 35*50 = 1750 байт информации. Информационный объем всей книги 1750(байт)*150(стр.) = 262500(байт) ≈ 256,348(Кб)

Ответ: 256,348(Кб)

2. Текстовое сообщение, содержащее 1048576 символов общепринятой кодировки, необходимо разместить на дискете ёмкостью 1,44Мб. Какая часть дискеты будет занята?

Решение: Т.к. кодировка общепринятая, то количество информации в одном символе - 8(бит). Т.о. информационный объем текстового сообщения V = 1048576*8(бит) = 8388608(бит) = 1048576(байт) = 1024(Кб) =1Мб.

Т.к. объем дискеты составляет 1,44 Мб, то текстовым сообщением будет занято 1Мб*100% / 1,44Мб = 69% объёма дискеты.

Ответ: 69% объёма дискеты будет занято переданным сообщением.

Задачи для самостоятельного решения

1. Мощность алфавита N=32. Какое количество информации несет одна буква?

2. Текст занимает 0,25 Кбайт памяти компьютера. Сколько символов содержит текст?

3. Сообщение, записанное буквами из 64 - символьного алфавита, содержит 10 символов. Какой объем информации в битах оно несет?

4. Информационное сообщение объемом 500 бит содержит 100 символов. Какова мощность алфавита?

5. Сколько символов содержит информационное сообщение, записанное с помощью 16 - символьного алфавита, если объем его составил 120 бит?

6. В книге 250 страниц. На каждой странице 60 строк, в каждой строке 80 символов. Вычислить информационный объем книги.

7. Свободный объем оперативной памяти компьютера 640 Кбайт. Сколько страниц книги поместится в ней, если на странице 32 строки по 64 символа (64 строки по 64 символа, 16 строк по 64 символа)?

8. Для записи текста использовали 256 – символьный алфавит. Каждая страница содержит 30 строк по 70 символов в строке. Какой объем информации содержат 5 страниц текста?

9. Для записи сообщения использовался 64 – символьный алфавит. Каждая страница содержит 30 строк. Всё сообщение содержит 8775 байтов информации и занимает 6 страниц. Сколько символов в строке?

10. Сведения о сотруднике хранятся в виде строки из 2048 символов. Сколько понадобятся дискет емкостью 1,2Мб для хранения сведений обо всех 8500 сотрудниках фирмы?

11. Емкость одного условного печатного листа приблизительно равна 32Кб (1 символ занимает 8 бит), скорость печати – 64 символа в секунду. Сколько минут потребуется без учета смены бумаги для распечатки текста одной газеты (2 усл.п.л.) на матричном принтере (ответ округлить до целого числа)?

12. Каково максимальное количество книг (каждая объемом 200 страниц, на каждой странице 60 строк, 80 символов в строке) размещаемых на лазерном диске емкостью 600 Мб?

13. Если досье на преступников занимают 45 Мб и каждое из них имеет объем 12 страниц (48 строк по 64 символа в каждой, 1 символ занимает 8 бит), чему равно число хранимых досье?

14. Два сообщения содержат одинаковое количество символов. Количество информации в первом тексте в 1,5 раза больше, чем во втором. Сколько символов содержат алфавиты, с помощью которых записаны сообщения, если известно, что число символов в каждом алфавите не превышает 10-ти, и на каждый символ приходится целое число битов?